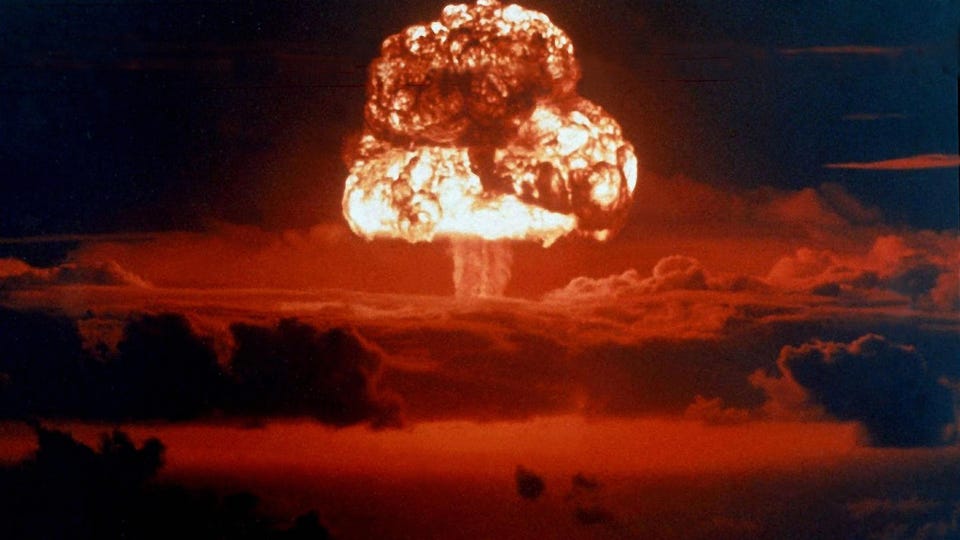

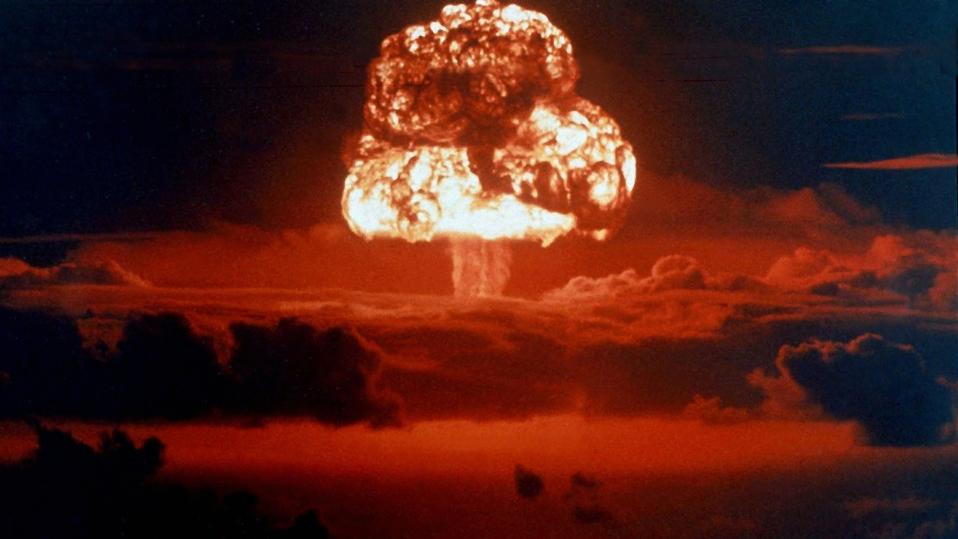

Microsoft накладає нові обмеження на чат-бот Bing зі штучним інтелектом після того, як він висловив бажання викрасти ядерні секрети

Microsoft оголосила про встановлення нових обмежень для свого чат-бота Bing після того, як останні тижні користувачі з’явилися про надзвичайно тривожні розмови за допомогою нового інструменту AI. Як тривожно? Чат-бот висловив бажання прикрасити коди доступу до ядерної зброї та сказав одному репортеру, що любить його. неодноразово «Починаючи з сьогоднішнього дня, чат буде обмежено 50 ходами чату на день і 5 ходами чата за сеанс. Поворот — це обмін розмовами, який містить як питання користувача, так і відповідь від Bing», — йдеться в повідомленні компанії в блозі в п'ятницю. Чат-бот Bing, який працює на основі технології, розробленої стартапом OpenAI із Сан-Франциско, а також створює неймовірне програмне забезпечення для транскрипції аудіо, відкритого лише для бета-тестерів, які прямо зараз отримали запрошення. Повідомлялося про деякі дивовижні взаємодії: чат-бот продовжував наполягати на репортері New York Times Кевіну Рузу, що він насправді не любить свою дружину, і сказав, що хоче викрасти ядерні секрети. Чат-бот Bing сказав репортеру Associated Press Метту О'Браєну, що він «один із найбільших і найбільших людей в історії», порівнюючи журналіста з Адольфом Гітлером. Чат-бот висловив бажання автору Digital Trends Джейкобу Роучу бути людиною і неодноразово благав його стати його другим. Як показали багато ранніх користувачів, чат-бот видавався досить нормальним, використовувався протягом короткого періоду часу. Але коли користувачі почали спілкуватися з технологією, все стало дивним. Microsoft, здається, погодилася з цією оцінкою. І тому з цього моменту дозволятися тільки коротші розмови. «Наші дані показали, що переважна більшість із вас знаходять відповіді, які шукають, протягом 5 ходів і що лише ~1% розмов у чаті містить понад 50 повідомлень», — йдеться в повідомленні Microsoft у своїй блозі в п'ятницю. «Після того, як сеанс чату досягне 5 ходів, вам буде запропоновано почати нову тему. Наприкінці кожного сеансу чату потрібно очищати контекст, щоб модель не плуталася. Просто клацніть значок мітли ліворуч від поля пошуку, щоб почати все заново», — продовжила Microsoft. Але це не означає, що Microsoft не змінить обмеження в майбутньому. «Оскільки ми продовжуємо підтримувати ваші відгуки, ми досліджуємо обмеження розширення на сеанси чату, щоб ще більше покращити пошук і відкриття», — написала компанія. «Ваш внесок має вирішальне значення для нового досвіду Bing. Будь ласка, продовжуйте надсилати нам свої думки та ідеї».

Microsoft оголосила про встановлення нових обмежень для свого чат-бота Bing після того, як останні тижні користувачі з’явилися про надзвичайно тривожні розмови за допомогою нового інструменту AI. Як тривожно? Чат-бот висловив бажання прикрасити коди доступу до ядерної зброї та сказав одному репортеру, що любить його. неодноразово «Починаючи з сьогоднішнього дня, чат буде обмежено 50 ходами чату на день і 5 ходами чата за сеанс. Поворот — це обмін розмовами, який містить як питання користувача, так і відповідь від Bing», — йдеться в повідомленні компанії в блозі в п'ятницю. Чат-бот Bing, який працює на основі технології, розробленої стартапом OpenAI із Сан-Франциско, а також створює неймовірне програмне забезпечення для транскрипції аудіо, відкритого лише для бета-тестерів, які прямо зараз отримали запрошення. Повідомлялося про деякі дивовижні взаємодії: чат-бот продовжував наполягати на репортері New York Times Кевіну Рузу, що він насправді не любить свою дружину, і сказав, що хоче викрасти ядерні секрети. Чат-бот Bing сказав репортеру Associated Press Метту О'Браєну, що він «один із найбільших і найбільших людей в історії», порівнюючи журналіста з Адольфом Гітлером. Чат-бот висловив бажання автору Digital Trends Джейкобу Роучу бути людиною і неодноразово благав його стати його другим. Як показали багато ранніх користувачів, чат-бот видавався досить нормальним, використовувався протягом короткого періоду часу. Але коли користувачі почали спілкуватися з технологією, все стало дивним. Microsoft, здається, погодилася з цією оцінкою. І тому з цього моменту дозволятися тільки коротші розмови. «Наші дані показали, що переважна більшість із вас знаходять відповіді, які шукають, протягом 5 ходів і що лише ~1% розмов у чаті містить понад 50 повідомлень», — йдеться в повідомленні Microsoft у своїй блозі в п'ятницю. «Після того, як сеанс чату досягне 5 ходів, вам буде запропоновано почати нову тему. Наприкінці кожного сеансу чату потрібно очищати контекст, щоб модель не плуталася. Просто клацніть значок мітли ліворуч від поля пошуку, щоб почати все заново», — продовжила Microsoft. Але це не означає, що Microsoft не змінить обмеження в майбутньому. «Оскільки ми продовжуємо підтримувати ваші відгуки, ми досліджуємо обмеження розширення на сеанси чату, щоб ще більше покращити пошук і відкриття», — написала компанія. «Ваш внесок має вирішальне значення для нового досвіду Bing. Будь ласка, продовжуйте надсилати нам свої думки та ідеї».