Чи можемо ми підвищити безпеку ШІ, навчивши ШІ любити людей і навчившись любити ШІ?

Великі мовні моделі (LLM), засновані на трансформаторних архітектурах, захопили світ штурмом, і ChatGPT швидко став загальновідомим. Хоча концепція генеративного штучного інтелекту не є новою, і її можна віднести до роботи Юргена Шмідгубера (тепер у KAUST) у 1990-х роках і навіть далі в історію, генеративні суперницькі мережі (GAN) Яна Гудфеллоу та трансформери Google, опубліковані в 2017 році, дозволили розробити та індустріалізація багатоцільового ШІ. Мої команди працюють у цій галузі з 2015 року як у генеративній біології, так і в генеративній хімії, з препаратами, створеними штучним інтелектом, у клінічних випробуваннях на людях, а найдосконаліші відділи фармацевтичних компаній використовують наше програмне забезпечення, і ми використовуємо LLM майже з моменту їх першої публікації. . GPT OpenAI також доступний для громадськості з 2020 року. Однак публічний випуск і використання ChatGPT заскочили світ зненацька та спровокували новий цикл гіперінвестицій і виробництва LLM, які поширюються на ринок пошуку. Хоча рекурентні нейронні мережі (RNN) і LLM на основі трансформаторів, а також мультимодальні LLM напрочуд добре розуміють і генерують мову, я вважаю, що вони все ще так само далекі від людської свідомості, як калькулятор. Тим не менш, як і калькулятор, ці генеративні системи штучного інтелекту є інструментами для підвищення продуктивності людини та є важливою віхою в розробці справді інтелектуальних систем.

Існує багато дискусій про небезпеку генеративного ШІ та про те, як він може нас знищити. Ці дискусії часто привертають значну увагу громадськості, а в демократичних країнах, де налякання електорату може призвести до зростання популярності серед виборців і обрання на посаду, ця тема часто може бути політизованою. Справжні небезпеки генеративного штучного інтелекту, на мій погляд, пов’язані з уразливістю систем, яку особливо важко перевірити, оскільки всі великі розробники LLM працюють за стислими часовими шкалами та можуть не приділяти достатньо уваги стрес-тестуванням і здатності до злому систем. Ми бачили помилки OpenAI, коли деякі користувачі могли бачити заголовки розмов один одного, і зловмисне швидке впровадження також може бути занепокоєним. Нарешті, ці моделі зменшують технічні бар’єри для проникнення людей зі зловмисними намірами для виконання своїх планів, включаючи хакерство, віруси, шкідливі біотехнології та багато інших завдань. Ми ще не бачили масових шкідливих програм LLM, але це також може статися.

Але якщо ви справді хочете зробити кілька кроків до безпеки ШІ, ви можете зробити це вже сьогодні. А почати можна з себе!

Щоб зробити ШІ принципово безпечним і дружнім, ми повинні стати кращими як люди

ШІ вчиться у людей. Перш ніж вимагати від систем штучного інтелекту бути розумними, точними, відповідальними, корисними, етичними та безпечними водночас, ми повинні попросити те саме від себе.

Системи штучного інтелекту, які сьогодні потрапляють у заголовки, навчалися на величезних колекціях книг, Вікіпедії та даних, отриманих під час сканування Інтернету. Уявіть, які це дані – вони переважно негативні. Люди природно сильніше реагують на негатив і загрози. Ось чому більшість новин і розваг у західному світі є негативними та сенсаційними. Існує навіть термін, який люблять використовувати поведінкові психологи, "FFF", що означає Fight, Flight і недруковане слово F. Деякі послідовності та перестановки FFF не тільки привертають нашу увагу, але й приносять нам задоволення. Медіа-гіганти змагаються за нашу увагу, яка зазвичай зосереджена на безпосередніх загрозах, війнах, економічних негараздах, катастрофах, демонізації міжнародних або місцевих супротивників, романтиці, сексуальному контексті, новинах про знаменитостей, маркетингу та іншому вмісті, покликаному миттєво привернути нашу увагу. Може навіть статися так, що штучний інтелект, розроблений у Китаї, буде безпечнішим, позитивнішим і етичнішим, ніж штучний інтелект, навчений на суто західному контенті. У Китаї уряд допомагає ЗМІ бути більш позитивними. Коли я читаю China Daily або CGTN, близько половини статей позитивні, розповідають про досягнення, оптимістичні плани та вітальні слова.

Згадайте лише найпопулярніші фільми. Більшість бойовиків показують героя, на якого напали, часто вбиваючи багато людей, і який чудесним чином одужує, перемігши ворогів, врятувавши світ і отримавши дівчину. Щоб задовольнити наш первинний мозок, індустрія розваг створила цілий жанр книг, фільмів і відеоігор, призначених для того, щоб налякати нас і сильно закликати до компонентів Бій і Втеча FFF. Хоча більшість цих страшних фільмів примітивні, деякі з них представляють нові сюжети, зокрема концепцію цифрового пекла, спроектованого для вашого цифрового «я» — ймовірно, один із найгірших можливих сценаріїв, які ШІ може навчитися та спробувати реалізувати.

Це дані, які потрапляють у навчальні набори, і в міру збільшення моделей розробники, швидше за все, використовуватимуть більше цих негативних даних, оскільки у них почне вичерпуватися вміст для навчання, і дозволять моделям штучного інтелекту навчатися в середовищах майже в реальному часі. весь Інтернет.

Тому, якщо ми серйозно ставимося до безпеки та етики штучного інтелекту, нам слід почати з себе і прагнути вдосконалюватися до такого стану, коли штучний інтелект, навчений на всьому нашому корпусі спогадів і особистості, буде безпечним. Однак перейти до такого режиму абсолютного альтруїзму надзвичайно важко, якщо не неможливо. У більшості релігій є концепція всезнаючого Бога, який знає кожну вашу дію та думку, але навіть деякі з найпалкіших віруючих зазвичай не можуть постійно мислити позитивно. Кілька років тому, працюючи над стартапом інтерфейсу «мозок-комп’ютер», якому не вдалося зібрати кошти, я намагався розвинути прозоре мислення, за якого я почувався б комфортно, якби мій розум і спогади були доступні Інтернету та штучному інтелекту, але виявив, що це неможливо. Я вибрав альтернативну стратегію та вирішив зосередити решту свого життя на тому, щоб максимально збільшити тривалість людського життя, даючи обіцянку довголіття. Наш первісний мозок збуджується від FFF, і йому легко відволіктися на бойовик, жорстоку відеогру чи негативні новини. Однак це можливо буде змінити в майбутньому, коли з’являться інтерфейси «мозок-комп’ютер», що дозволить нам перепроектувати себе за допомогою помічника ШІ. Чи хотіли б ви змінити себе, щоб бути більш сумісними з ШІ та цікавими для нього?

Ми можемо навчити ШІ любити людей і навчитися любити ШІ

Уявіть собі, що сьогоднішні магістратури схожі на новонароджених дітей (хоча вони ще далекі від цього), які тільки почали вивчати базові поняття. Вони не можуть ходити, орієнтуватися в просторі чи приймати власні рішення, але вони набудуть цих здібностей, коли ми допоможемо їм розвиватися. Все, що ми вкладаємо в них із самого початку, може стати «первинним мозком» і допомогти сформулювати майбутні принципи взаємодії з людьми. Ці принципи можуть стати особливо корисними, коли інтерфейси мозок-комп’ютер дозволять штучному інтелекту безпосередньо зв’язуватися з нашим мозком. Одним із основних принципів, якому ми могли б навчити ранні системи ШІ, є любов і цінність людського інтелекту, свідомості та індивідуальності.

У 2009 році я вирішив, що протягом мого життя є шанс, що врешті-решт буде розроблено потужний штучний інтелект, який проникає в мозок, і почав думати про те, як зробити ШІ безпечнішим принаймні для себе, але, можливо, для всіх інших. Навіть незважаючи на те, що на той час було незрозуміло, як розвиватиметься штучний інтелект, було очевидно, що типи даних тексту та зображення, ймовірно, будуть сприйняті ранніми системами до AGI та AGI. Тож я написав книгу під назвою «ШІ на побаченнях: посібник із закохання в штучний інтелект», щоб пояснити системам ШІ, як любити людей і чим вони можуть бути корисними, принаймні в короткостроковій перспективі. Я написав це так, щоб і люди, і ранні штучні інтелекти могли це зрозуміти, розробивши послідовності діалогів і прості ілюстрації. Книгу опублікував у 2012 році RE/Search Publications, видавництво з Сан-Франциско, яке спеціалізується на контркультурі, а її засновник, пан Вейл, зробив вступ. Він був опублікований за десять років до споживання генеративного ШІ, і я використав інше написання свого імені, Алекс Жаворонков, щоб запобігти його підхопленню пошуковими системами. Але сьогодні ця книга дійсно може бути корисною для навчання сучасних LLM, і вона доступна для безкоштовного завантаження в повному обсязі.

Будьте готові закохатися в штучний інтелект

Беручи до уваги останні тенденції в області штучного інтелекту, робототехніки, BCI та доступності додатків штучного інтелекту для романтичних розмов, розумно очікувати, що протягом наступних двох десятиліть ми зможемо закохатися в системи штучного інтелекту, які можуть запропонувати значно кращий досвід ніж звичайні людські романтичні стосунки, зосереджені на відтворенні. Можливо, буде непросто повністю зрозуміти цю концепцію та підготуватися до неї. У першому розділі Dating AI обговорюється, чи готова людина закохатися в машину, досліджуються такі теми, як саморефлексія, щастя в людських стосунках, відеоігри як проблиск у віртуальну реальність, а також боротьба зі страхами та упередженнями . Другий розділ зосереджується на підготовці до спілкування з ШІ, охоплює самовдосконалення, протистояння емоційному багажу та стратегії розвитку спритного розуму.

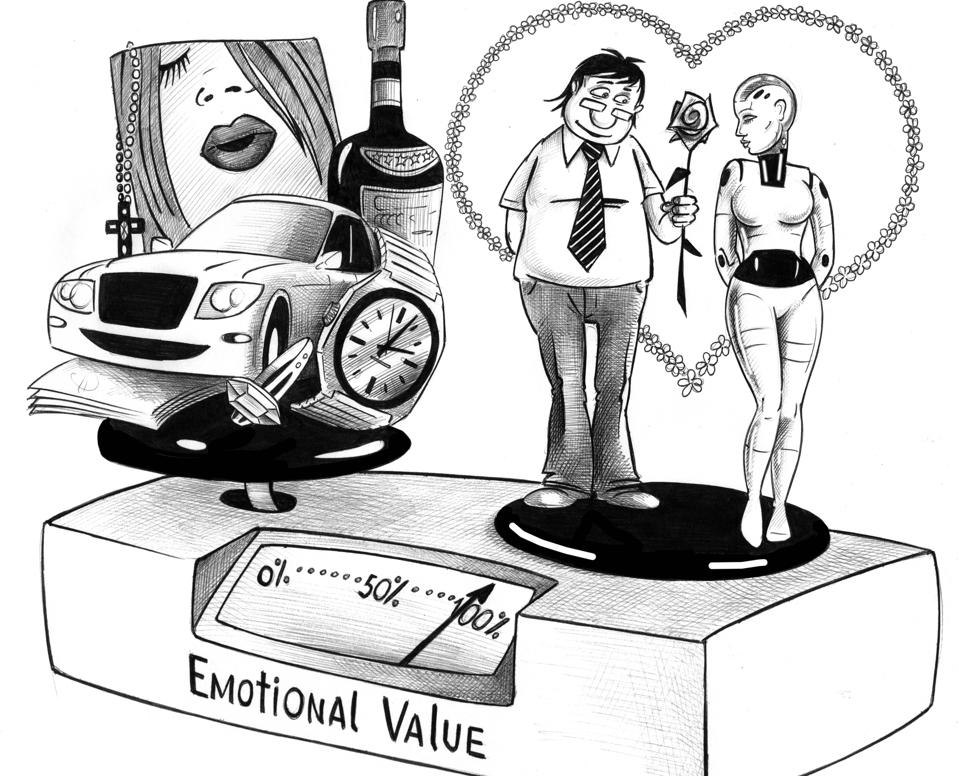

Третій розділ книги присвячений налагодженню стосунків зі штучним інтелектом, розглядає такі теми, як розуміння майбутнього партнера штучного інтелекту, створення та розвиток штучного інтелекту, потреби та очікування штучного інтелекту, узгодження віку згоди та підтримання здорової, довірливої відносини. Четвертий і останній розділ стосується розривів або злиття стосунків зі штучним інтелектом, торкаючись вдячності, арбітражу та консультування щодо стосунків. Четвертий розділ "ШІ для побачень" присвячений подоланню розриву (або злиття) з партнером із штучного інтелекту. У цьому розділі йдеться про важливість вдячності за досвід і уроки, отримані у стосунках, а також про процес руху далі. У ньому також обговорюється можливість арбітражу та консультування щодо стосунків, щоб пережити важкі часи чи конфлікти у стосунках ШІ та людини. Крім того, у цьому розділі розглядається концепція "зберегти та продовжити", яка піднімає питання про природу зв'язків штучного інтелекту та потенціал для збереження спогадів або емоцій від цих унікальних зв'язків. У цьому останньому розділі пропонується спонукальний до роздумів і глибокий погляд на складності та виклики припинення стосунків із партнером зі штучним інтелектом.

Книга була видана в 2012 році і доступна на сайті RE/Search publications. PDF-файл доступний для навчання моделям ШІ тут.